從磁盤到網(wǎng)絡(luò) 詳解服務(wù)器數(shù)據(jù)處理服務(wù)的核心硬件基石

在當(dāng)今以數(shù)據(jù)為中心的數(shù)字時代,服務(wù)器作為數(shù)據(jù)處理服務(wù)的核心載體,其性能直接關(guān)系到業(yè)務(wù)系統(tǒng)的穩(wěn)定、高效與安全。其中,磁盤(存儲子系統(tǒng))和網(wǎng)卡(網(wǎng)絡(luò)子系統(tǒng))作為數(shù)據(jù)“存儲”與“流動”的關(guān)鍵硬件,是構(gòu)建強(qiáng)大數(shù)據(jù)處理服務(wù)的物理基石。深入理解這兩大組件,對于設(shè)計、優(yōu)化和運維數(shù)據(jù)處理服務(wù)至關(guān)重要。

一、 服務(wù)器磁盤:數(shù)據(jù)的持久化家園

磁盤子系統(tǒng)負(fù)責(zé)數(shù)據(jù)的持久化存儲,其性能、可靠性和容量是數(shù)據(jù)處理服務(wù)的根本。

1. 主要類型與技術(shù)演進(jìn):

* 機(jī)械硬盤(HDD):傳統(tǒng)選擇,依靠磁頭和盤片工作。優(yōu)勢在于容量大、成本低,適合存儲冷數(shù)據(jù)或?qū)OPS(每秒輸入輸出操作次數(shù))要求不高的場景。但尋道時間和轉(zhuǎn)速限制了其隨機(jī)讀寫性能。

- 固態(tài)硬盤(SSD):現(xiàn)代服務(wù)器的標(biāo)準(zhǔn)配置。基于NAND閃存,無機(jī)械部件,具有極高的隨機(jī)讀寫IOPS和低延遲。根據(jù)接口和協(xié)議,可分為SATA SSD、SAS SSD以及性能更極致的NVMe SSD(直接通過PCIe通道與CPU通信)。NVMe SSD已成為高性能數(shù)據(jù)庫、實時分析等數(shù)據(jù)處理服務(wù)的首選。

2. 關(guān)鍵性能指標(biāo):

* IOPS:衡量隨機(jī)讀寫能力的關(guān)鍵,直接影響數(shù)據(jù)庫事務(wù)、虛擬化啟動等場景的響應(yīng)速度。

- 吞吐量(Throughput):順序讀寫時的數(shù)據(jù)轉(zhuǎn)移速率,單位通常是MB/s或GB/s,影響大文件傳輸、視頻處理等。

- 延遲(Latency):從發(fā)出請求到收到響應(yīng)的時間,對用戶體驗和系統(tǒng)實時性至關(guān)重要,SSD相比HDD有數(shù)量級優(yōu)勢。

3. 部署與優(yōu)化實踐:

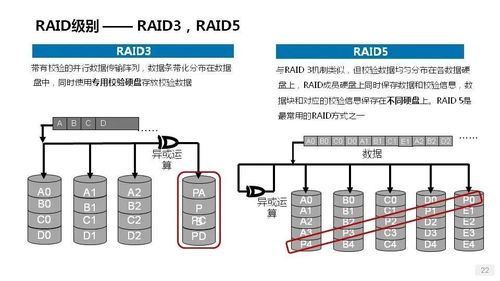

* RAID技術(shù):通過磁盤陣列提升性能、容量或可靠性。如RAID 0(條帶化,提升性能)、RAID 1(鏡像,提升可靠性)、RAID 5/6(分布式校驗,平衡性能與可靠性)。在SSD時代,RAID仍需謹(jǐn)慎配置以避免寫放大等問題。

- 緩存策略:服務(wù)器通常配備電池/電容保護(hù)的寫緩存(WB),能大幅提升寫入性能,但需確保在意外斷電時數(shù)據(jù)能安全刷入磁盤。

- 與數(shù)據(jù)處理服務(wù)的結(jié)合:根據(jù)服務(wù)類型選擇存儲方案。例如,OLTP數(shù)據(jù)庫追求高IOPS和低延遲,應(yīng)選用NVMe SSD并可能配置為RAID 10;而大數(shù)據(jù)分析平臺可能采用HDD與SSD分層存儲,熱數(shù)據(jù)存于SSD,冷數(shù)據(jù)歸檔至HDD。

二、 服務(wù)器網(wǎng)卡:數(shù)據(jù)的高速通道

網(wǎng)卡是服務(wù)器與外部世界進(jìn)行數(shù)據(jù)交換的橋梁,其性能決定了數(shù)據(jù)“流動”的效率。

1. 類型與速率演進(jìn):

* 傳統(tǒng)以太網(wǎng)卡:從千兆(1GbE)發(fā)展到萬兆(10GbE)、25GbE、40GbE,直至如今的100GbE、200GbE甚至400GbE。速率提升是應(yīng)對數(shù)據(jù)中心東西向流量(服務(wù)器間通信)爆炸式增長的核心手段。

- 智能網(wǎng)卡與DPU:這是近年來的革命性發(fā)展。智能網(wǎng)卡(SmartNIC)或數(shù)據(jù)處理單元(DPU)不僅負(fù)責(zé)網(wǎng)絡(luò)包轉(zhuǎn)發(fā),更集成了強(qiáng)大的多核處理器,能夠卸載主CPU的網(wǎng)絡(luò)協(xié)議棧(如TCP/IP)、虛擬交換(OVS)、存儲(NVMe-oF)、安全加密甚至特定計算任務(wù)(如AI推理),從而釋放寶貴的CPU核心用于核心業(yè)務(wù)邏輯,極大提升整體數(shù)據(jù)處理效率。

2. 關(guān)鍵特性與技術(shù):

* RDMA(遠(yuǎn)程直接內(nèi)存訪問):允許一臺服務(wù)器直接訪問另一臺服務(wù)器的內(nèi)存,無需操作系統(tǒng)內(nèi)核介入,實現(xiàn)超低延遲和高帶寬的數(shù)據(jù)傳輸。RoCE(RDMA over Converged Ethernet)和InfiniBand是其主流實現(xiàn)。對于高性能計算(HPC)、分布式存儲(如Ceph)和機(jī)器學(xué)習(xí)訓(xùn)練集群至關(guān)重要。

- 多隊列與RSS:現(xiàn)代網(wǎng)卡支持多隊列,并能通過接收端縮放(RSS)將網(wǎng)絡(luò)流量分發(fā)到多個CPU核心上并行處理,解決單核瓶頸,提升網(wǎng)絡(luò)處理性能。

- 虛擬化支持:如SR-IOV(單根I/O虛擬化),允許一張物理網(wǎng)卡虛擬出多個輕量級虛擬功能(VF)直接分配給虛擬機(jī),繞過虛擬化層,獲得接近物理機(jī)的網(wǎng)絡(luò)性能。

3. 在數(shù)據(jù)處理服務(wù)中的角色:

* 微服務(wù)與API通信:高速、低延遲的網(wǎng)卡保障了分布式微服務(wù)間頻繁的RPC/API調(diào)用。

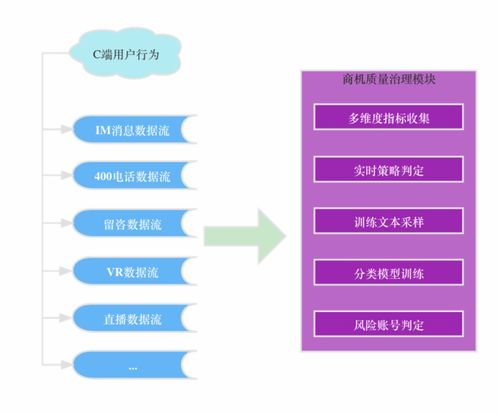

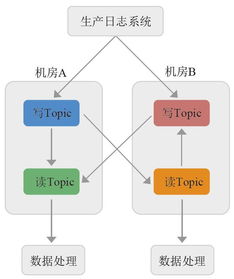

- 數(shù)據(jù)采集與分發(fā):在流處理(如Kafka、Flink)或日志收集系統(tǒng)中,高吞吐量的網(wǎng)卡能應(yīng)對海量數(shù)據(jù)的實時攝入與輸出。

- 存儲網(wǎng)絡(luò)分離:在生產(chǎn)環(huán)境中,常將存儲流量(如iSCSI、NFS、Ceph)與業(yè)務(wù)網(wǎng)絡(luò)流量通過不同物理網(wǎng)卡或VLAN進(jìn)行隔離,避免相互干擾,確保穩(wěn)定性。

- 云原生與可編程性:DPU/智能網(wǎng)卡通過卸載Kubernetes服務(wù)網(wǎng)格、網(wǎng)絡(luò)安全策略(如Calico、Cilium),正在成為云原生基礎(chǔ)設(shè)施的新支柱。

三、 協(xié)同構(gòu)建高效數(shù)據(jù)處理服務(wù)

優(yōu)秀的服務(wù)器數(shù)據(jù)處理服務(wù),是磁盤、網(wǎng)卡與CPU、內(nèi)存協(xié)同工作的結(jié)果。

- 平衡設(shè)計:避免“木桶效應(yīng)”。為CPU密集型服務(wù)(如科學(xué)計算)配備超高帶寬和RDMA網(wǎng)卡的也需確保存儲IO不成為瓶頸(如配置NVMe SSD)。反之,對于IO密集型服務(wù)(如對象存儲),在部署大量磁盤的也需足夠的網(wǎng)絡(luò)帶寬將數(shù)據(jù)輸送出去。

- 軟件棧優(yōu)化:硬件潛力需通過軟件釋放。使用異步I/O(如Linux AIO)、輪詢模式(如SPDK for storage, DPDK for network)替代傳統(tǒng)中斷模式,能極大降低延遲,提升磁盤和網(wǎng)卡的效率。選擇支持RDMA的通信中間件(如gRPC)或分布式文件系統(tǒng)也能帶來質(zhì)的飛躍。

- 監(jiān)控與洞察:建立完善的監(jiān)控體系,關(guān)注磁盤的IOPS、延遲、利用率以及網(wǎng)卡的帶寬、丟包率、錯包率。利用這些指標(biāo)進(jìn)行容量規(guī)劃、性能調(diào)優(yōu)和故障預(yù)警。

****

服務(wù)器磁盤和網(wǎng)卡已從簡單的存儲和連接部件,演變?yōu)楦叨戎悄芑⒖删幊痰臄?shù)據(jù)處理加速引擎。理解其原理、類型、性能指標(biāo)及最佳實踐,是構(gòu)建高性能、高可靠、可擴(kuò)展的現(xiàn)代數(shù)據(jù)處理服務(wù)的必備知識。隨著DPU、NVMe-oF、計算存儲等技術(shù)的融合發(fā)展,未來的數(shù)據(jù)處理服務(wù)硬件基石將更加緊密協(xié)同,為上層應(yīng)用提供更強(qiáng)大、更透明的數(shù)據(jù)動力。

如若轉(zhuǎn)載,請注明出處:http://www.0817nc.cn/product/70.html

更新時間:2026-04-28 04:59:23